热门话题

#

Bonk 生态迷因币展现强韧势头

#

有消息称 Pump.fun 计划 40 亿估值发币,引发市场猜测

#

Solana 新代币发射平台 Boop.Fun 风头正劲

基于平均对数概率的简单置信度度量用于过滤推理轨迹。再次强调,得益于高质量开源模型的访问,这项研究非常出色。

期待越来越强大的管道,采用"生成器-验证器"架构来修剪不良结果。验证器可以是模型实例,或者某种数学函数,比如本文中开发的内部置信度指标。现有模型在与这种管道和大令牌预算结合使用时非常强大。(在这里,AIME 2025使用了大约1E8个令牌。)

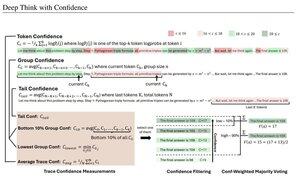

"DeepConf利用模型内部的置信度信号,在生成过程中或之后动态过滤低质量的推理轨迹。它不需要额外的模型训练或超参数调整,可以无缝集成到现有的服务框架中。我们在各种推理任务和最新的开源模型上评估DeepConf,包括Qwen 3和GPT-OSS系列。值得注意的是,在AIME 2025等具有挑战性的基准测试中,DeepConf@512的准确率高达99.9%,并且与完全并行思维相比,生成的令牌减少了多达84.7%。"

注意这些Meta研究人员使用开源模型Qwen、GPT-OSS和DeepSeek,但没有使用Llama的讽刺 😢

8月23日 04:00

介绍 DeepConf:自信地深思

🚀 首个使用开源模型在 AIME 2025 上实现 99.9% 的方法!即使没有工具,使用 GPT-OSS-120B,我们也达到了几乎完美的准确率,同时节省了多达 85% 的生成令牌。

它还为并行思维提供了许多强大的优势:

🔥 性能提升:模型和数据集的准确率提高约 10%

⚡ 超高效:生成的令牌减少多达 85%

🔧 即插即用:与任何现有模型兼容 - 无需训练(也无需超参数调整!)

⭐ 易于部署:在 vLLM 中只需 ~50 行代码(见下面的 PR)

📚 论文:

🌐 项目:

与以下人员共同合作:@FuYichao123 , xuewei_wang, @tydsh

(请查看下面的评论中的详细信息)

5.07K

热门

排行

收藏