Trendande ämnen

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

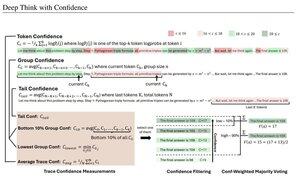

Enkla konfidensmått baserade på genomsnittlig logitaritmisk sannolikhet som används för att filtrera resonemangsspår. Återigen, mycket trevlig forskning som möjliggörs av tillgång till högkvalitativa modeller med öppen källkod.

Leta efter fler och kraftfullare pipelines med "generator-verifier"-arkitektur som rensar bort dåliga resultat. Verifieraren kan vara en modellinstans eller någon form av matematisk funktion som de interna konfidensmått som utvecklats i det här dokumentet. Befintliga modeller är mycket kraftfulla när de används med den här typen av pipeline och stora tokenbudgetar. (Här, ~1E8 tokens som används för AIME 2025.)

"DeepConf utnyttjar modellinterna konfidenssignaler för att dynamiskt filtrera bort resonemang av låg kvalitet under eller efter generering. Det kräver ingen ytterligare modellträning eller justering av hyperparametrar och kan sömlöst integreras i befintliga betjänande ramverk. Vi utvärderar DeepConf över en mängd olika resonemangsuppgifter och de senaste modellerna med öppen källkod, inklusive Qwen 3 och GPT-OSS-serien. Noterbart är att på utmanande riktmärken som AIME 2025 uppnår DeepConf@512 upp till 99,9 % noggrannhet och minskar genererade tokens med upp till 84,7 % jämfört med helt parallellt tänkande."

Observera ironin i att dessa Meta-forskare använder OS-modellerna Qwen, GPT-OSS och DeepSeek, men ingen Lama 😢

23 aug. 04:00

Vi presenterar DeepConf: Deep Think with Confidence

🚀 Första metoden att uppnå 99,9% på AIME 2025 med modeller med öppen källkod! Genom att använda GPT-OSS-120B även utan verktyg uppnådde vi denna nästan perfekta noggrannhet samtidigt som vi sparade upp till 85 % genererade tokens.

Det ger också många starka fördelar för parallellt tänkande:

🔥 Prestandaökning: ~10 % noggrannhet i alla modeller och datauppsättningar

⚡ Ultraeffektiv: Upp till 85 % färre genererade tokens

🔧 Plug & play: Fungerar med ALLA befintliga modeller - ingen träning behövs (ingen justering av hyperparametrar också!)

⭐ Lätt att distribuera: Bara ~50 rader kod i vLLM (se PR nedan)

📚 Papper:

🌐 Projekt:

Gemensamt arbete med: @FuYichao123, xuewei_wang, @tydsh

(se detaljer i kommentarerna nedan)

5,1K

Topp

Rankning

Favoriter