Chủ đề thịnh hành

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

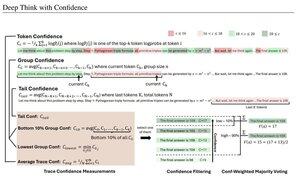

Các biện pháp tự tin đơn giản dựa trên xác suất log trung bình được sử dụng để lọc các dấu vết lý luận. Một lần nữa, nghiên cứu rất hay được thực hiện nhờ vào việc truy cập vào các mô hình mã nguồn mở chất lượng cao.

Hãy tìm kiếm nhiều quy trình mạnh mẽ hơn với kiến trúc "generator-verifier" mà loại bỏ các kết quả kém. Bộ xác minh có thể là một phiên bản mô hình, hoặc một loại hàm toán học nào đó như các chỉ số tự tin nội bộ được phát triển trong tài liệu này. Các mô hình hiện có rất mạnh mẽ khi được sử dụng với loại quy trình này và ngân sách token lớn. (Ở đây, ~1E8 token được sử dụng cho AIME 2025.)

"DeepConf tận dụng các tín hiệu tự tin nội bộ của mô hình để lọc động các dấu vết lý luận chất lượng thấp trong quá trình hoặc sau khi tạo ra. Nó không yêu cầu đào tạo mô hình bổ sung hoặc điều chỉnh siêu tham số và có thể được tích hợp liền mạch vào các khung phục vụ hiện có. Chúng tôi đánh giá DeepConf trên nhiều nhiệm vụ lý luận và các mô hình mã nguồn mở mới nhất, bao gồm Qwen 3 và series GPT-OSS. Đáng chú ý, trên các tiêu chuẩn thách thức như AIME 2025, DeepConf@512 đạt được độ chính xác lên đến 99.9% và giảm số token được tạo ra lên đến 84.7% so với tư duy song song đầy đủ."

Lưu ý sự mỉa mai của các nhà nghiên cứu Meta này khi sử dụng các mô hình mã nguồn mở Qwen, GPT-OSS và DeepSeek, nhưng không có Llama 😢

04:00 23 thg 8

Giới thiệu DeepConf: Suy nghĩ sâu sắc với sự tự tin

🚀 Phương pháp đầu tiên đạt 99.9% trên AIME 2025 với các mô hình mã nguồn mở! Sử dụng GPT-OSS-120B ngay cả khi không có công cụ, chúng tôi đã đạt được độ chính xác gần như hoàn hảo trong khi tiết kiệm tới 85% số token được tạo ra.

Nó cũng mang lại nhiều lợi thế mạnh mẽ cho tư duy song song:

🔥 Tăng cường hiệu suất: ~10% độ chính xác trên các mô hình & tập dữ liệu

⚡ Siêu hiệu quả: Giảm tới 85% số token được tạo ra

🔧 Cắm & chạy: Hoạt động với BẤT KỲ mô hình hiện có nào - không cần đào tạo (cũng không cần tinh chỉnh siêu tham số!)

⭐ Dễ triển khai: Chỉ ~50 dòng mã trong vLLM (xem PR bên dưới)

📚 Tài liệu:

🌐 Dự án:

công việc chung với: @FuYichao123 , xuewei_wang, @tydsh

(xem chi tiết trong các bình luận bên dưới)

5K

Hàng đầu

Thứ hạng

Yêu thích