热门话题

#

Bonk 生态迷因币展现强韧势头

#

有消息称 Pump.fun 计划 40 亿估值发币,引发市场猜测

#

Solana 新代币发射平台 Boop.Fun 风头正劲

以下是我们在当今以人工智能为中心的世界中需要@Mira_Network的原因👇

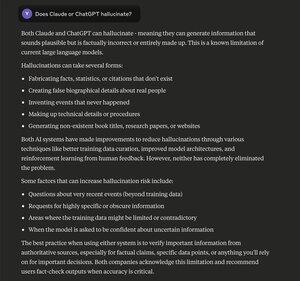

→ 人工智能输出的错误率大约为30%,但听起来很有说服力

→ 当需要准确性时,例如医疗、法律、金融决策,问题变得严重

→ Mira通过多个模型对人工智能声明进行共识验证

→ 在检查之前将响应分解为更小的可验证部分

→ 多个人工智能模型独立对每个声明的有效性进行投票

→ 只有经过验证的声明才能通过最终输出

→ 使用工作量证明(PoW)进行验证,即节点必须运行实际的推理任务

→ 验证者因不诚实行为而面临失去代币的风险

→ 通过共享声明而不是底层源数据来维护隐私

→ 没有中央权威决定什么算是真实

→ 通过API集成与现有的人工智能系统协作

→ 使开发者能够为他们的应用程序添加验证层

→ 经济模型奖励准确的验证工作

→ 设计用于高风险用例,其中错误会产生实际后果

→ TGE即将到来

当前的人工智能强大但不可靠。@Mira_Network致力于提高可靠性。

624

热门

排行

收藏