熱門話題

#

Bonk 生態迷因幣展現強韌勢頭

#

有消息稱 Pump.fun 計劃 40 億估值發幣,引發市場猜測

#

Solana 新代幣發射平臺 Boop.Fun 風頭正勁

這就是為什麼我們在當今以 AI 為中心的世界中需要 @Mira_Network 👇

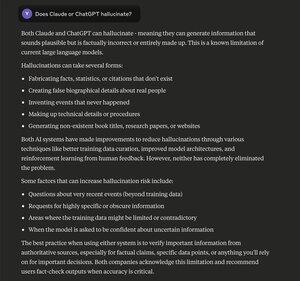

→ AI 輸出大約有 30% 的錯誤率,但聽起來很有說服力

→ 當你需要像醫療、法律、金融決策這樣的準確性時,問題變得嚴重

→ Mira 通過多個模型運行 AI 申請以進行共識驗證

→ 在檢查之前將回應分解為更小的可驗證部分

→ 多個 AI 模型獨立對每個申請的有效性進行投票

→ 只有經過驗證的申請才能通過最終輸出

→ 使用 PoW 進行驗證,即節點必須運行實際的推理任務

→ 驗證者因不誠實行為而面臨失去代幣的風險

→ 通過共享申請而不是底層源數據來維護隱私

→ 沒有中央權威決定什麼算是真實的

→ 通過 API 集成與現有的 AI 系統協作

→ 使開發者能夠為他們的應用程序添加驗證層

→ 經濟模型獎勵準確的驗證工作

→ 為高風險用例設計,錯誤會帶來真實後果

→ TGE 即將到來

當前的 AI 強大但不可靠。@Mira_Network 專注於可靠性部分。

615

熱門

排行

收藏