Topik trending

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Inilah mengapa kita membutuhkan @Mira_Network di dunia👇 AI yang berpusat pada saat ini

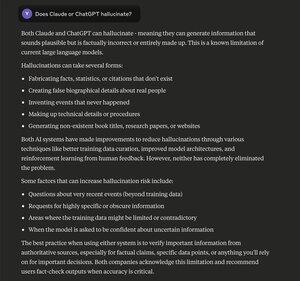

→ output AI memiliki tingkat kesalahan sekitar 30% tetapi terdengar meyakinkan

→ Masalah menjadi serius ketika Anda membutuhkan akurasi seperti keputusan medis, hukum, keuangan

→ Mira menjalankan klaim AI melalui beberapa model untuk verifikasi konsensus

→ Memecah respons menjadi bagian-bagian yang lebih kecil yang dapat diverifikasi sebelum memeriksa

→ Beberapa model AI memberikan suara secara independen pada validitas setiap klaim

→ Hanya klaim terverifikasi yang masuk ke output akhir

→ Menggunakan PoW untuk validasi yaitu node harus menjalankan tugas inferensi aktual

→ Validator berisiko kehilangan token karena perilaku tidak jujur

→ Privasi dipertahankan dengan berbagi klaim, bukan data sumber yang mendasarinya

→ Tidak ada otoritas pusat yang memutuskan apa yang dianggap benar

→ Bekerja dengan sistem AI yang ada melalui integrasi API

→ Memungkinkan pengembang menambahkan lapisan verifikasi ke aplikasi mereka

→ Model ekonomi menghargai pekerjaan validasi yang akurat

→ Dirancang untuk kasus penggunaan berisiko tinggi di mana kesalahan memiliki konsekuensi nyata

→ TGE masuk

AI saat ini kuat tetapi tidak dapat diandalkan. @Mira_Network bekerja pada bagian keandalan.

601

Teratas

Peringkat

Favorit