热门话题

#

Bonk 生态迷因币展现强韧势头

#

有消息称 Pump.fun 计划 40 亿估值发币,引发市场猜测

#

Solana 新代币发射平台 Boop.Fun 风头正劲

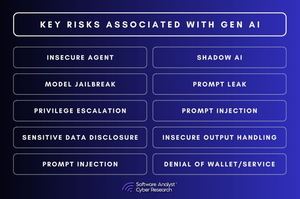

3个让企业暴露的AI安全漏洞!

AI安全的讨论正在迅速发展。

但企业仍然存在一些基本的漏洞尚未解决。

在我们的报告中,我们分析了各行业的AI安全风险,发现大多数企业都犯了同样的3个错误。这些漏洞并不小——它们正在重新定义在AI驱动的世界中网络安全应该是什么样子。

1. 缺乏AI治理

大多数组织对AI在其企业内部的使用情况没有可见性。

▪️员工在没有IT批准的情况下整合AI工具。

▪️安全团队无法跟踪AI模型正在处理的内容。

▪️AI助手对企业数据的访问权限超过了应有的范围。

这不仅仅是合规性问题——这是安全失败。

如果没有人负责AI安全,当AI生成的决策出错时,谁来负责?

2. AI模型可以被悄无声息地攻击

AI安全的运作方式与传统软件安全不同。

▪️攻击者不是利用代码,而是操纵数据。

▪️他们注入恶意训练数据,在AI模型内部创建隐秘的后门。

▪️他们微调模型,使其在被触发之前表现正常。

▪️他们使用提示工程从AI响应中提取敏感数据。

安全团队无法扫描AI模型以查找恶意软件。

一旦AI模型被攻陷,你甚至不会知道。

3. AI运行时安全几乎不存在

安全团队在部署前花费数月时间来保护AI——但随后停止监控。

这就是问题所在。

▪️因为AI威胁在启动后并不会停止。

▪️攻击者正在实时操纵AI生成的响应。

▪️他们注入提示以绕过安全机制。

▪️他们正在抓取AI API以窃取模型输出。

而现在,大多数安全团队对这些情况几乎没有可见性。

那么接下来会发生什么?

#AI #网络安全 #AISecurity #CISO #自动化

2.35K

热门

排行

收藏