Popularne tematy

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

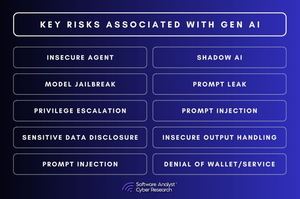

3 luki w zabezpieczeniach AI, które narażają przedsiębiorstwa!

Rozmowa na temat bezpieczeństwa AI rozwija się szybko.

Jednak istnieją fundamentalne luki, które przedsiębiorstwa wciąż nie zaadresowały.

W naszym raporcie przeanalizowaliśmy ryzyka związane z bezpieczeństwem AI w różnych branżach i odkryliśmy, że większość przedsiębiorstw popełnia te same 3 błędy. A te luki nie są małe — redefiniują, jak powinno wyglądać bezpieczeństwo cybernetyczne w świecie napędzanym przez AI.

1. Brak zarządzania AI

Większość organizacji nie ma wglądu w to, jak AI jest wykorzystywane w ich przedsiębiorstwie.

▪️Pracownicy integrują narzędzia AI bez zatwierdzenia IT.

▪️Zespoły bezpieczeństwa nie mogą śledzić, jakie modele AI przetwarzają dane.

▪️AI copiloty mają większy dostęp do danych przedsiębiorstwa, niż powinny.

To nie jest tylko problem zgodności — to porażka w zakresie bezpieczeństwa.

Jeśli nikt nie odpowiada za bezpieczeństwo AI, kto ponosi odpowiedzialność, gdy decyzja wygenerowana przez AI jest błędna?

2. Modele AI mogą być cicho hakowane

Bezpieczeństwo AI nie działa jak tradycyjne bezpieczeństwo oprogramowania.

▪️Zamiast wykorzystywać kod, napastnicy manipulują danymi.

▪️Wstrzykują złośliwe dane treningowe, tworząc ciche tylne drzwi w modelach AI.

▪️Dostosowują modele, aby działały normalnie, aż do momentu wyzwolenia.

▪️Używają inżynierii podpowiedzi, aby wydobyć wrażliwe dane z odpowiedzi AI.

Zespoły bezpieczeństwa nie mogą skanować modelu AI w poszukiwaniu złośliwego oprogramowania.

A gdy model AI zostanie skompromitowany, nawet o tym nie będziesz wiedział.

3. Bezpieczeństwo w czasie działania AI nie istnieje

Zespoły bezpieczeństwa spędzają miesiące na zabezpieczaniu AI przed wdrożeniem — ale potem przestają je monitorować.

To jest problem.

▪️Ponieważ zagrożenia związane z AI nie kończą się w momencie uruchomienia.

▪️Napastnicy manipulują odpowiedziami generowanymi przez AI w czasie rzeczywistym.

▪️Wstrzykują podpowiedzi, aby obejść mechanizmy bezpieczeństwa.

▪️Zbierają dane z interfejsów API AI, aby ukraść wyniki modeli.

A w tej chwili większość zespołów bezpieczeństwa ma minimalny wgląd w to wszystko.

Co się stanie dalej?

#AI #Cyberbezpieczeństwo #BezpieczeństwoAI #CISO #Automatyzacja

2,31K

Najlepsze

Ranking

Ulubione