Populære emner

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

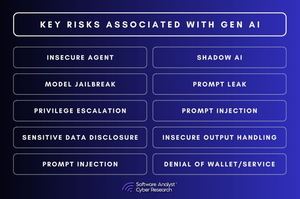

De 3 AI-sikkerhetshullene som etterlater bedrifter utsatt!

AI-sikkerhetssamtalen går raskt.

Men det er grunnleggende hull som bedrifter fortsatt ikke har tatt tak i.

For rapporten vår analyserte vi AI-sikkerhetsrisikoer på tvers av bransjer og fant ut at de fleste bedrifter gjør de samme 3 feilene. Og disse hullene er ikke små – de omdefinerer hvordan cybersikkerhet må se ut i en AI-drevet verden.

1. AI-styring mangler

De fleste organisasjoner har ingen innsyn i hvordan AI brukes i bedriften.

▪️Ansatte integrerer AI-verktøy uten IT-godkjenning.

▪️Sikkerhetsteam kan ikke spore hva AI-modeller behandler.

▪️AI-copiloter har mer tilgang til bedriftsdata enn de burde.

Dette er ikke bare et samsvarsproblem – det er en sikkerhetssvikt.

Hvis ingen eier AI-sikkerhet, hvem er ansvarlig når en AI-generert beslutning går galt?

2. AI-modeller kan hackes lydløst

AI-sikkerhet fungerer ikke som tradisjonell programvaresikkerhet.

▪️I stedet for å utnytte kode, manipulerer angripere data.

▪️De injiserer ondsinnede treningsdata og skaper stille bakdører inne i AI-modeller.

▪️De finjusterer modeller til å oppføre seg normalt til de utløses.

▪️De bruker rask engineering for å trekke ut sensitive data fra AI-svar.

Sikkerhetsteam kan ikke skanne en AI-modell for skadelig programvare.

Og når en AI-modell er kompromittert, vil du ikke engang vite det.

3. AI-kjøretidssikkerhet er ikke-eksisterende

Sikkerhetsteam bruker måneder på å sikre kunstig intelligens før distribusjon – men slutter deretter å overvåke den.

Det er et problem.

▪️Fordi AI-trusler ikke stopper ved lansering.

▪️Angripere manipulerer AI-genererte svar i sanntid.

▪️De injiserer meldinger for å omgå sikkerhetsmekanismer.

▪️De skraper AI-API-er for å stjele modellutdata.

Og akkurat nå har de fleste sikkerhetsteam minimal innsyn i noe av dette.

Så hva skjer videre?

#AI #Cybersecurity #AISecurity #CISO #Automation

2,36K

Topp

Rangering

Favoritter