Trend-Themen

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

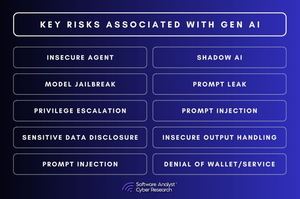

Die 3 AI-Sicherheitslücken, die Unternehmen ungeschützt lassen!

Die Diskussion über AI-Sicherheit bewegt sich schnell.

Aber es gibt grundlegende Lücken, die Unternehmen immer noch nicht angegangen sind.

Für unseren Bericht haben wir die AI-Sicherheitsrisiken in verschiedenen Branchen analysiert und festgestellt, dass die meisten Unternehmen die gleichen 3 Fehler machen. Und diese Lücken sind nicht klein – sie definieren neu, wie Cybersicherheit in einer von AI getriebenen Welt aussehen muss.

1. AI-Governance fehlt

Die meisten Organisationen haben keine Sichtbarkeit darüber, wie AI innerhalb ihres Unternehmens genutzt wird.

▪️Mitarbeiter integrieren AI-Tools ohne Genehmigung der IT.

▪️Sicherheitsteams können nicht verfolgen, welche AI-Modelle verarbeitet werden.

▪️AI-Copiloten haben mehr Zugriff auf Unternehmensdaten, als sie sollten.

Das ist nicht nur ein Compliance-Problem – es ist ein Sicherheitsversagen.

Wenn niemand für die AI-Sicherheit verantwortlich ist, wer ist dann verantwortlich, wenn eine AI-generierte Entscheidung schiefgeht?

2. AI-Modelle können stillschweigend gehackt werden

AI-Sicherheit funktioniert nicht wie traditionelle Software-Sicherheit.

▪️Anstatt Code auszunutzen, manipulieren Angreifer Daten.

▪️Sie injizieren bösartige Trainingsdaten und schaffen stille Hintertüren in AI-Modellen.

▪️Sie optimieren Modelle, um normal zu funktionieren, bis sie ausgelöst werden.

▪️Sie verwenden Prompt-Engineering, um sensible Daten aus AI-Antworten zu extrahieren.

Sicherheitsteams können ein AI-Modell nicht auf Malware scannen.

Und sobald ein AI-Modell kompromittiert ist, werden Sie es nicht einmal wissen.

3. AI-Runtime-Sicherheit existiert nicht

Sicherheitsteams verbringen Monate damit, AI vor der Bereitstellung abzusichern – hören dann aber auf, es zu überwachen.

Das ist ein Problem.

▪️Denn AI-Bedrohungen hören nicht mit dem Start auf.

▪️Angreifer manipulieren AI-generierte Antworten in Echtzeit.

▪️Sie injizieren Prompts, um Sicherheitsmechanismen zu umgehen.

▪️Sie scrapen AI-APIs, um Modell-Ausgaben zu stehlen.

Und im Moment haben die meisten Sicherheitsteams nur minimale Sichtbarkeit in all dies.

Was passiert als Nächstes?

#AI #Cybersicherheit #AISicherheit #CISO #Automatisierung

2,36K

Top

Ranking

Favoriten