トレンドトピック

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

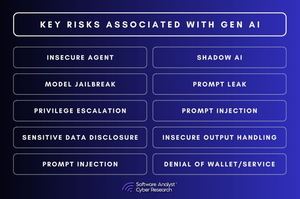

企業をさらけ出している 3 つの AI セキュリティ ギャップ!

AI セキュリティに関する会話は急速に進んでいます。

しかし、企業がまだ対処していない根本的なギャップがあります。

私たちのレポートでは、業界全体の AI セキュリティ リスクを分析したところ、ほとんどの企業が同じ 3 つの間違いを犯していることがわかりました。そして、これらのギャップは小さくなく、AI 主導の世界でサイバーセキュリティがどのようなものであるかを再定義しています。

1. AIガバナンスが欠けている

ほとんどの組織は、企業内でAIがどのように使用されているかを可視化していません。

▪️従業員はIT部門の承認なしにAIツールを統合しています。

▪️セキュリティチームは、AI モデルが処理しているものを追跡できません。

▪️AI コパイロットは、必要以上にエンタープライズ データにアクセスできます。

これは単なるコンプライアンスの問題ではなく、セキュリティの失敗でもあります。

AIセキュリティを誰も所有していない場合、AIが生成した決定が間違った場合、誰が責任を負うのでしょうか?

2. AIモデルは静かにハッキングされる可能性がある

AIセキュリティは、従来のソフトウェアセキュリティのようには機能しません。

▪️攻撃者はコードを悪用する代わりに、データを操作します。

▪️悪意のあるトレーニング データを挿入し、AI モデル内にサイレント バックドアを作成します。

▪️トリガーされるまで正常に動作するようにモデルを微調整します。

▪️彼らはプロンプトエンジニアリングを使用して、AI応答から機密データを抽出します。

セキュリティチームは、AI モデルでマルウェアをスキャンすることはできません。

そして、AIモデルが侵害されると、あなたはそれに気付かなくなります。

3. AIランタイムのセキュリティが存在しない

セキュリティチームは、導入前に AI の保護に数か月を費やしますが、その後は監視を停止します。

それは問題です。

▪️なぜなら、AIの脅威は発売から止まらないからです。

▪️攻撃者は AI が生成した応答をリアルタイムで操作しています。

▪️彼らは安全メカニズムを回避するためのプロンプトを注入しています。

▪️彼らは AI API をスクレイピングしてモデル出力を盗んでいます。

そして現在、ほとんどのセキュリティチームは、これらをほとんど可視化していません。

では、次に何が起こるでしょうか?

#AI #Cybersecurity #AISecurity #CISO #Automation

2.35K

トップ

ランキング

お気に入り