Актуальні теми

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Це трохи закопує леде, який полягає в тому, що з незначною зміною ви також можете зробити ReLU(A @ B) @ C на NxN матрицях з N проміжними значеннями і без переобчислення.

(Він же: нейронна мережа.)

8 серп., 23:42

Всі знають про Flash Attention. А чи знаєте ви про Flash GEMM?

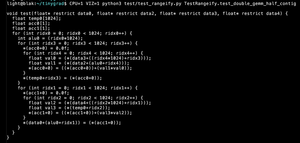

Цей код обчислює (A @ B) @ C на NxN матрицях з N проміжними продуктами і без повторного обчислення. Якщо ви не використовуєте бібліотеку BLAS, вам не потрібно матеріалізувати проміжну матрицю.

25,39K

Найкращі

Рейтинг

Вибране