Tópicos em alta

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Isso está enterrando um pouco o lede, que é que com uma pequena mudança você também pode fazer ReLU(A @ B) @ C em matrizes NxN com N intermediários e sem recomputação.

(também conhecido como: uma rede neural.)

8 de ago., 23:42

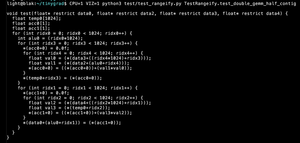

Todo mundo conhece o Flash Attention. Mas você conhece o Flash GEMM?

Este código calcula (A @ B) @ C em matrizes NxN com N intermediários e sem recomputação. Se você não usar uma biblioteca BLAS, não precisará materializar a matriz intermediária.

25,4K

Melhores

Classificação

Favoritos