Актуальные темы

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Это немного скрывает суть, а именно то, что с небольшим изменением вы также можете выполнить ReLU(A @ B) @ C на матрицах NxN с N промежуточными значениями и без повторных вычислений.

(иначе говоря: нейронная сеть.)

8 авг., 23:42

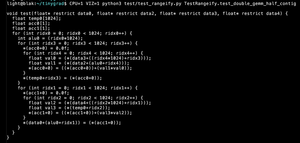

Everyone knows about Flash Attention. But do you know about Flash GEMM?

This code computes (A @ B) @ C on NxN matrices with N intermediates and no recomputation. If you don't use a BLAS library, you don't need to materialize the intermediate matrix.

25,4K

Топ

Рейтинг

Избранное