Trendande ämnen

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Detta är att begrava den lede lite, vilket är att med en mindre ändring kan du också göra ReLU(A @ B) @ C på NxN-matriser med N intermediärer och ingen omräkning.

(även kallat ett neuralt nätverk.)

8 aug. 2025

Everyone knows about Flash Attention. But do you know about Flash GEMM?

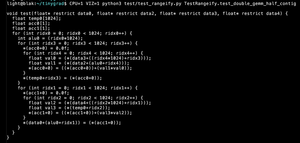

This code computes (A @ B) @ C on NxN matrices with N intermediates and no recomputation. If you don't use a BLAS library, you don't need to materialize the intermediate matrix.

25,4K

Topp

Rankning

Favoriter