Populære emner

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Likte virkelig @beffjezos av @extropic sin analogi for termodynamikk i denne podkasten

Han nevner Maxwells demon 👹, et vesen som brenner energi for å strengt ordne molekyler (varme eller kalde) i to rom.

Dette hjalp meg å understreke forskjellen mellom GPUer og Thermo for meg

Med AI spiller vi demonen ved å tvinge transistorer inn i rigide tilstander bare for å holde én parameter. Hver er et tall mellom 0 og 1. Vi forbrenner enorm energi i prosessen for å bekjempe entropi og opprettholde disse spesifikke tallene

Dette, sammen med det enorme antallet GPU-er, er grunnen til at vi trenger kjernekraftreaktorer og enorme mengder energi for å drive datasentre

Matematisk sett er en parameter fast, men fysisk sett er det å holde presisjonen en konstant kamp mot varme. Digitale brikker må bruke enorm energi for å forsterke signalet over den naturlige termiske støyen bare for å forhindre at dataene tilfeldiggjøres. Dette er grunnen til at strømregningene går Brrrr med GPU-er

Termodynamisk databehandling slutter å kjempe mot fysikken. Den behandler termiske fluktuasjoner som en ressurs snarere enn en feil, og bruker dem til å naturlig prøve fordelingen. Det er helt annerledes.

I stedet for å bruke masseenergi for å opprettholde strenge tall og lene oss inn i dette kaoset/tilfeldigheten, kan vi kjøre AI-modeller med mange størrelsesordener mindre energi

Dette tar oss av det endeløse kraft-/beregningstoget vi nå er på for AI

Jeg er i starten av forskningen min her, så jeg har nok tatt feil

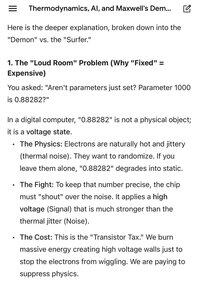

De vedlagte bildene er en veldig nyttig sammenligning fra Gemini om forskjellen mellom digitalt og termisk

Topp

Rangering

Favoritter