Temas en tendencia

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Me gustó mucho @beffjezos de la analogía de @extropic sobre la termodinámica en este podcast

Menciona al Demonio 👹 de Maxwell, un ser que quema energía para ordenar estrictamente las moléculas (calientes o frías) en dos habitaciones.

Esto me ayudó a notar la diferencia entre GPUs y termodinámica

Con la IA, jugamos como el Demonio al forzar transistores a estados rígidos solo para mantener un solo parámetro. Cada uno es un número entre 0 y 1. Quemamos una energía masiva en el proceso para combatir la entropía y mantener estos números específicos

Esto y el enorme número de GPUs es la razón por la que necesitamos reactores nucleares y enormes cantidades de energía para hacer funcionar los centros de datos

Matemáticamente, un parámetro es fijo, pero físicamente, mantener esa precisión es una lucha constante contra el calor. Los chips digitales deben consumir una energía masiva para amplificar la señal sobre el ruido térmico natural solo para evitar que los datos se aleatoricen. Por eso las facturas de energía se vuelven Brrrr con las GPUs

La computación termodinámica deja de luchar contra la física. Trata las fluctuaciones térmicas como un recurso y no como un error y las utiliza para muestrear naturalmente la distribución. Es totalmente diferente.

En lugar de usar la energía de masa para mantener números estrictos y aprovechar este caos/aleatoriedad, podemos ejecutar modelos de IA con órdenes de magnitud menos de energía

Esto nos saca del interminable tren de energía/cómputo en el que estamos ahora para la IA

Estoy empezando mi investigación aquí, así que probablemente me haya equivocado en algo

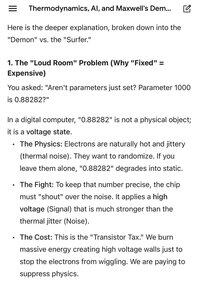

Las fotos adjuntas son una comparación muy útil de Gemini sobre la diferencia entre digital y térmico

Populares

Ranking

Favoritas