Argomenti di tendenza

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Non puoi costruire prodotti AI come altri prodotti.

I prodotti AI sono intrinsecamente non deterministici e devi costantemente negoziare il compromesso tra agenzia e controllo.

Quando i team non riconoscono queste differenze, i loro prodotti affrontano fallimenti inaspettati, rimangono bloccati a fare debug di sistemi complessi che non possono tracciare e la fiducia degli utenti nel prodotto si erode silenziosamente.

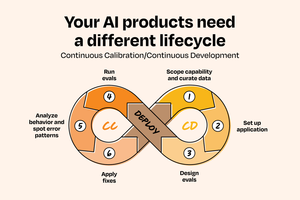

Dopo aver visto questo schema ripetersi in oltre 50 implementazioni di AI in aziende come @OpenAI, @Google, @Amazon e @Databricks, Aishwarya Naresh Reganti e Kiriti Badam hanno sviluppato una soluzione: il framework Continuous Calibration/Continuous Development (CC/CD).

Il nome è un riferimento a Continuous Integration/Continuous Deployment (CI/CD), ma, a differenza del suo omonimo, è destinato a sistemi in cui il comportamento è non deterministico e l'agenzia deve essere guadagnata.

Questo framework ti mostra come:

- Iniziare con funzionalità ad alta controllo e bassa agenzia

- Costruire sistemi di valutazione che funzionano realmente

- Scalare i prodotti AI senza compromettere la fiducia degli utenti

È progettato per riconoscere l'unicità dei sistemi AI e aiutarti a costruire prodotti AI più intenzionali, stabili e affidabili.

Lo stanno condividendo pubblicamente per la prima volta:

120,49K

Principali

Ranking

Preferiti