Subiecte populare

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Nu poți construi produse AI ca alte produse.

Produsele AI sunt în mod inerent non-deterministe și trebuie să negociați în mod constant compromisul dintre agenție și control.

Când echipele nu recunosc aceste diferențe, produsele lor se confruntă cu eșecuri neașteptate, sunt blocate în depanarea sistemelor mari și complicate pe care nu le pot urmări, iar încrederea utilizatorilor în produs se erodează în liniște.

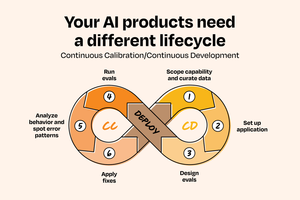

După ce au văzut acest model în 50+ implementări AI la companii precum @OpenAI, @Google, @Amazon și @Databricks, Aishwarya Naresh Reganti și Kiriti Badam au dezvoltat o soluție: cadrul de calibrare continuă/dezvoltare continuă (CC/CD).

Numele este o referire la Continuous Integration/Continuous Deployment (CI/CD), dar, spre deosebire de omonimul său, este destinat sistemelor în care comportamentul este non-determinist și trebuie câștigată agenția.

Acest cadru vă arată cum:

- Începeți cu funcții cu control ridicat și agenție scăzută

- Construiți sisteme de evaluare care funcționează cu adevărat

- Scalați produsele AI fără a încălca încrederea utilizatorilor

Este conceput pentru a recunoaște unicitatea sistemelor AI și pentru a vă ajuta să construiți produse AI mai intenționate, stabile și de încredere.

Îl împărtășesc public pentru prima dată:

120,5K

Limită superioară

Clasament

Favorite