Rubriques tendance

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Vous ne pouvez pas construire des produits d'IA comme d'autres produits.

Les produits d'IA sont intrinsèquement non déterministes, et vous devez constamment négocier le compromis entre l'autonomie et le contrôle.

Lorsque les équipes ne reconnaissent pas ces différences, leurs produits rencontrent des échecs inattendus, elles se retrouvent coincées à déboguer de grands systèmes compliqués qu'elles ne peuvent pas tracer, et la confiance des utilisateurs dans le produit s'érode silencieusement.

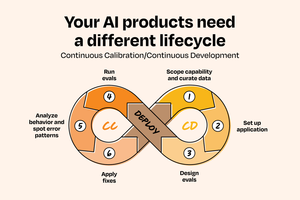

Après avoir observé ce schéma se reproduire dans plus de 50 mises en œuvre d'IA dans des entreprises telles que @OpenAI, @Google, @Amazon et @Databricks, Aishwarya Naresh Reganti et Kiriti Badam ont développé une solution : le cadre de Calibration Continue/Développement Continu (CC/CD).

Le nom fait référence à l'Intégration Continue/Déploiement Continu (CI/CD), mais, contrairement à son homologue, il est destiné à des systèmes où le comportement est non déterministe et où l'autonomie doit être acquise.

Ce cadre vous montre comment :

- Commencer avec des fonctionnalités à contrôle élevé et autonomie faible

- Construire des systèmes d'évaluation qui fonctionnent réellement

- Élargir les produits d'IA sans briser la confiance des utilisateurs

Il est conçu pour reconnaître l'unicité des systèmes d'IA et vous aider à construire des produits d'IA plus intentionnels, stables et dignes de confiance.

Ils le partagent publiquement pour la première fois :

120,51K

Meilleurs

Classement

Favoris