熱門話題

#

Bonk 生態迷因幣展現強韌勢頭

#

有消息稱 Pump.fun 計劃 40 億估值發幣,引發市場猜測

#

Solana 新代幣發射平臺 Boop.Fun 風頭正勁

Artificial Analysis

獨立分析 AI 模型和託管供應商 - 為您的用例選擇最佳模型和 API 供應商

DeepSeek推出V3.1,將V3和R1統一為一個混合推理模型,智能水平逐步提升

智能水平逐步提升:DeepSeek V3.1的初步基準測試結果顯示,推理模式下的人工分析智能指數為60,較R1的59有所上升。在非推理模式下,V3.1的得分為49,較早期的V3 0324得分44有了更大的提升。這使得V3.1(推理)落後於阿里巴巴最新的Qwen3 235B 2507(推理)——DeepSeek尚未重新奪回領先地位。

混合推理:@deepseek_ai首次採用混合推理模型,支持推理和非推理模式。DeepSeek轉向統一的混合推理模型模仿了OpenAI、Anthropic和Google的做法。然而,值得注意的是,阿里巴巴最近放棄了他們之前偏好的混合方法,分別發布了Qwen3 2507推理和指令模型。

功能調用/工具使用:雖然DeepSeek聲稱模型的功能調用有所改善,但DeepSeek V3.1在推理模式下不支持功能調用。這可能會大大限制其支持具有智能要求的代理工作流程的能力,包括在編碼代理中的應用。

令牌使用:DeepSeek V3.1在推理模式下的得分比DeepSeek R1略高,並且在我們用於人工分析智能指數的評估中使用的令牌略少。在非推理模式下,它使用的令牌比V3 0324略多——但仍然是其推理模式使用的令牌的幾倍。

API:DeepSeek的第一方API現在在他們的聊天和推理端點上服務於新的DeepSeek V3.1模型——只需在聊天模板中更改是否提供結束思考</think>令牌,以控制模型是否進行推理。

架構:DeepSeek V3.1在架構上與之前的V3和R1模型完全相同,具有671B的總參數和37B的活躍參數。

影響:我們建議在對這一發布所暗示的DeepSeek在未來模型(傳聞稱為V4或R2)進展方面做出任何假設時保持謹慎。我們注意到,DeepSeek之前在2024年12月10日發布了基於其V2架構的最終模型,僅在發布V3的兩週前。

71.25K

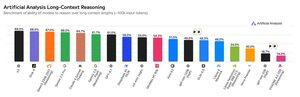

宣布人工分析長文推理(AA-LCR),這是一個新的基準,用於通過測試多個長文檔中的推理能力來評估長文檔性能(約100k個標記)

AA-LCR的重點是複製真實的知識工作和推理任務,測試對於現代AI應用至關重要的能力,涵蓋文檔分析、代碼庫理解和複雜的多步工作流程。

AA-LCR包含100個基於文本的困難問題,這些問題需要在多個現實世界文檔中進行推理,代表約100k個輸入標記。問題的設計使得答案無法直接找到,而必須從多個信息來源中推理出來,並且人類測試驗證每個問題都需要真正的推斷,而不是檢索。

關鍵要點:

➤ 當前領先的模型達到約70%的準確率:前三名分別是OpenAI o3(69%)、xAI Grok 4(68%)和Qwen3 235B 2507 Thinking(67%)

➤👀 我們也已經有gpt-oss的結果!120B的表現接近o4-mini(高),與OpenAI關於模型性能的聲明一致。我們將很快跟進模型的智能指數。

➤ 100個基於文本的困難問題,涵蓋7類文檔(公司報告、行業報告、政府諮詢、學術界、法律、營銷材料和調查報告)

➤ 每個問題約100k個輸入標記,要求模型支持至少128K的上下文窗口才能在此基準上得分

➤ 約300萬個獨特的輸入標記,涵蓋約230個文檔以運行基準(輸出標記通常因模型而異)

➤ 下面是🤗 @HuggingFace上的數據集鏈接

我們將AA-LCR添加到人工分析智能指數中,並將版本號提升至v2.2。人工分析智能指數v2.2現在包括:MMLU-Pro、GPQA Diamond、AIME 2025、IFBench、LiveCodeBench、SciCode和AA-LCR。

所有數字現在已在網站上更新。查看哪些模型在人工分析智能指數v2.2中表現良好👇

28.99K

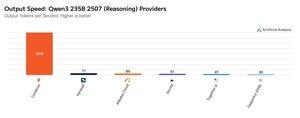

Cerebras 本週展示了其以非常高的速度托管大型 MoE 的能力,推出了 Qwen3 235B 2507 和 Qwen3 Coder 480B 端點,輸出速度超過 1,500 個標記/秒

➤ @CerebrasSystems 現在提供 Qwen3 235B 2507 推理和非推理的端點。這兩個模型的總參數為 235B,活躍參數為 22B。

➤ Qwen 3 235B 2507 推理提供的智能可與 o4-mini(高)和 DeepSeek R1 0528 相媲美。非推理變體的智能可與 Kimi K2 相媲美,並且遠超過 GPT-4.1 和 Llama 4 Maverick。

➤ Qwen3 Coder 480B 的總參數為 480B,活躍參數為 35B。這個模型在代理編碼方面特別強大,可以用於各種編碼代理工具,包括 Qwen3-Coder CLI。

Cerebras 的推出代表了這種智能首次以這些輸出速度可用,並有潛力解鎖新的用例——例如,使用推理模型來處理代理的每一步,而不必等待幾分鐘。

25.39K

熱門

排行

收藏