Popularne tematy

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Artificial Analysis

Niezależna analiza modeli AI i dostawców usług hostingowych - wybierz najlepszego dostawcę modelu i API dla swojego przypadku użycia

Alibaba wydało Qwen3 Next 80B: model hybrydowy z otwartymi wagami, który osiąga inteligencję na poziomie DeepSeek V3.1 przy zaledwie 3B aktywnych parametrów

Kluczowe informacje:

💡 Nowa architektura: Pierwszy model wprowadzający modele bazowe @Alibaba_Qwen 'Qwen3-Next', z kilkoma kluczowymi decyzjami architektonicznymi, takimi jak hybrydowy mechanizm uwagi Gated DeltaNet i Gated Attention oraz wysoka rzadkość z udziałem 3,8% aktywnych parametrów, w porównaniu do 9,4% dla Qwen3 235B

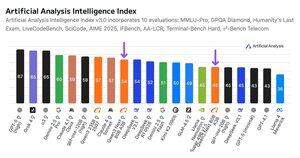

🧠 Inteligencja: Qwen3 Next 80B (Rozumowanie) uzyskuje 54 w Indeksie Inteligencji Analizy Sztucznej, plasując się obok DeepSeek V3.1 (Rozumowanie). Wariant bez rozumowania uzyskuje 45, zgodnie z gpt-oss-20B i Llama Nemotron Super 49B v1.5 (Rozumowanie)

💲 Model cenowy: Cena za token na @alibaba_cloud wynosi 0,5 USD/6 USD za 1M tokenów wejściowych/wyjściowych dla rozumowania i 0,5 USD/2 USD dla wariantu bez rozumowania. To w porównaniu do wyższych cen dla Qwen3 235B 2507 wynoszących 0,7 USD/8,4 USD z rozumowaniem i 0,7 USD/2,8 USD bez - redukcja ≥25% w zależności od obciążenia

⚙️ Szczegóły modelu: Model ma natywny kontekst okna 256k tokenów i jest tylko tekstowy, bez multimodalnych wejść lub wyjść. Przy zaledwie 80B parametrów w FP8 model mieści się na pojedynczym GPU H200

20

Uruchamiamy naszą ankietę "Stan Mediów Generatywnych 2025" wspieraną przez @fal! Weź udział, aby otrzymać pełny raport z ankiety i wygrać parę okularów Meta Ray-Ban 🕶️

Przeprowadzamy ankietę, aby zebrać informacje na temat stanu Mediów Generatywnych w 2025 roku. Obejmuje to perspektywy na temat tego, jak organizacje korzystają, wybierają i uzyskują dostęp do modeli Obrazów, Wideo i Muzyki!

Dlaczego warto wziąć udział?

✅ Otrzymaj darmową kopię rozszerzonego raportu z ankiety (tylko ograniczona wersja będzie dostępna publicznie)

✅ Szansa na wygranie pary okularów Ray-Ban Meta AI 🕶️

✅ Przyczyń się do dzielenia się spostrzeżeniami na temat kluczowych trendów kształtujących Media Generatywne

Link w wątku poniżej! ⬇️⬇️⬇️⬇️⬇️⬇️⬇️

114

DeepSeek uruchamia V3.1, łącząc V3 i R1 w hybrydowy model rozumowania z stopniowym wzrostem inteligencji

Stopniowy wzrost inteligencji: Wstępne wyniki benchmarków dla DeepSeek V3.1 pokazują wskaźnik Inteligencji Analizy Sztucznej na poziomie 60 w trybie rozumowania, w porównaniu do wyniku R1 wynoszącego 59. W trybie nie-rozumowania V3.1 osiąga wynik 49, co stanowi większy wzrost w porównaniu do wcześniejszego wyniku V3 0324 wynoszącego 44. To pozostawia V3.1 (rozumienie) za najnowszym Qwen3 235B 2507 Alibaba (rozumienie) - DeepSeek nie odzyskał prowadzenia.

Hybrydowe rozumowanie: @deepseek_ai po raz pierwszy przeszedł na hybrydowy model rozumowania - wspierając zarówno tryby rozumowania, jak i nie-rozumowania. Przejście DeepSeek na zjednoczony hybrydowy model rozumowania naśladuje podejście przyjęte przez OpenAI, Anthropic i Google. Warto jednak zauważyć, że Alibaba niedawno porzucił swoje preferencje dotyczące hybrydowego podejścia dla Qwen3, wydając osobno modele rozumowania i instrukcji Qwen3 2507.

Wywoływanie funkcji / użycie narzędzi: Chociaż DeepSeek twierdzi, że poprawił wywoływanie funkcji dla modelu, DeepSeek V3.1 nie obsługuje wywoływania funkcji w trybie rozumowania. Prawdopodobnie znacznie ograniczy to jego zdolność do wspierania agentowych przepływów pracy z wymaganiami inteligencji, w tym w agentach kodujących.

Użycie tokenów: DeepSeek V3.1 osiąga stopniowo wyższe wyniki w trybie rozumowania niż DeepSeek R1 i używa nieco mniej tokenów w ocenach, które wykorzystujemy do wskaźnika Inteligencji Analizy Sztucznej. W trybie nie-rozumowania używa nieco więcej tokenów niż V3 0324 - ale wciąż kilka razy mniej niż w swoim własnym trybie rozumowania.

API: Pierwsze API DeepSeek teraz obsługuje nowy model DeepSeek V3.1 zarówno na ich punktach końcowych czatu, jak i rozumowania - wystarczy zmienić, czy token końcowy myślenia </think> jest dostarczany do modelu w szablonie czatu, aby kontrolować, czy model będzie rozumował.

Architektura: DeepSeek V3.1 jest architektonicznie identyczny z wcześniejszymi modelami V3 i R1, z 671B całkowitych parametrów i 37B aktywnych parametrów.

Implikacje: Zalecamy ostrożność w formułowaniu jakichkolwiek założeń dotyczących tego, co ta wersja implikuje na temat postępów DeepSeek w kierunku przyszłego modelu, który w plotkach nazywany jest V4 lub R2. Zauważamy, że DeepSeek wcześniej wydał ostateczny model zbudowany na swojej architekturze V2 10 grudnia 2024 roku, zaledwie dwa tygodnie przed wydaniem V3.

406

Najlepsze

Ranking

Ulubione