トレンドトピック

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Artificial Analysis

AIモデルとホスティングプロバイダーの独立した分析 - ユースケースに最適なモデルとAPIプロバイダーを選択します

DeepSeekがV3.1を発表し、V3とR1をハイブリッド推論モデルに統合し、インテリジェンスを段階的に向上させる

インテリジェンスの増加: DeepSeek V3.1 の初期ベンチマーク結果では、推論モードでの人工分析知能指数は R1 のスコア 59 から 60 に上昇しました。非推論モードでは、V3.1 は 49 のスコアを達成し、以前の V3 0324 スコアの 44 から大幅に増加しています。これにより、V3.1 (推論) はアリババの最新の Qwen3 235B 2507 (推論) に遅れをとっています - DeepSeek はリードを取り戻していません。

ハイブリッド推論: @deepseek_ai は初めてハイブリッド推論モデルに移行し、推論モードと非推論モードの両方をサポートします。DeepSeek の統合ハイブリッド推論モデルへの移行は、OpenAI、Anthropic、Google が採用したアプローチを模倣しています。ただし、興味深いことに、アリババは最近、Qwen3 2507推論モデルと指示モデルを個別にリリースし、Qwen3に好まれたハイブリッドアプローチを放棄しました。

関数呼び出し/ツールの使用: DeepSeek はモデルの関数呼び出しが改善されたと主張していますが、DeepSeek V3.1 は推論モード時の関数呼び出しをサポートしていません。これにより、エージェントのコーディングを含め、インテリジェンス要件を持つエージェントワークフローをサポートする能力が大幅に制限される可能性があります。

トークンの使用状況: DeepSeek V3.1 は、推論モードで DeepSeek R1 よりもスコアが徐々に高く、人工分析知能インデックスに使用する評価全体で使用するトークンの数がわずかに少なくなります。非推論モードでは、V3 0324 よりもわずかに多くのトークンを使用しますが、それでも独自の推論モードよりも数倍少ないです。

API: DeepSeekのファーストパーティAPIは、チャットエンドポイントと推論エンドポイントの両方で新しいDeepSeek V3.1モデルを提供するようになりました - </think> チャットテンプレートで最終思考トークンがモデルに提供されるかどうかを変更して、モデルが推論するかどうかを制御するだけです。

アーキテクチャ: DeepSeek V3.1 は、以前の V3 および R1 モデルとアーキテクチャ的に同一で、合計パラメータは 671B で、アクティブ パラメータは 37B です。

含意: このリリースが、噂では V4 または R2 と呼ばれる将来のモデルに向けた DeepSeek の進歩について何を意味するかについて仮定を立てる際には注意することをお勧めします。DeepSeek は以前、V3 リリースのわずか 2 週間前の 2024 年 12 月 10 日に V2 アーキテクチャに基づいて構築された最終モデルをリリースしていたことに注意してください。

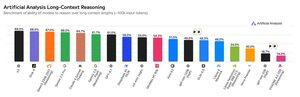

71.14K

複数の長いドキュメント(~100kトークン)にわたる推論能力のテストを通じて長いコンテキストのパフォーマンスを評価する新しいベンチマークであるArtificial Analysis Long Context Reasoning(AA-LCR)を発表

AA-LCRの焦点は、実際の知識作業と推論タスクを再現し、ドキュメント分析、コードベースの理解、複雑なマルチステップワークフローにまたがる最新のAIアプリケーションに不可欠な機能をテストすることです。

AA-LCRは、~100kの入力トークンを表す複数の現実世界のドキュメントにわたる推論を必要とする100のハードテキストベースの質問です。質問は、答えを直接見つけることができず、複数の情報源から推論する必要があるように設計されており、人間のテストにより、各質問には検索ではなく真の推論が必要であることが検証されます。

重要なポイント:

➤ 今日の主要なモデルは~70%の精度を達成しています:上位3位はOpenAI o3(69%)、xAI Grok 4(68%)、Qwen3 235B 2507 Thinking(67%)です。

➤ 👀 gpt-oss の結果もすでにあります。120B は o4-mini (高) に近いパフォーマンスを発揮し、モデルのパフォーマンスに関する OpenAI の主張と一致しています。モデルのインテリジェンスインデックスをまもなくフォローアップする予定です。

➤ 7つのカテゴリのドキュメント(企業レポート、業界レポート、政府相談、学術、法律、マーケティング資料、調査レポート)にまたがる100のハードテキストベースの質問

➤ 質問ごとに~100Kの入力トークンがあり、このベンチマークでスコアを獲得するには、モデルが最低128Kのコンテキストウィンドウをサポートする必要があります

➤ ベンチマークを実行するための~230ドキュメントにまたがる合計~3Mの一意の入力トークン(出力トークンは通常、モデルによって異なります)

➤ @HuggingFace の🤗データセットへのリンクは以下のとおりです

人工分析知能インデックスに AA-LCR を追加し、バージョン番号を v2.2 にします。Artificial Analysis Intelligence Index v2.2 には、MMLU-Pro、GPQA Diamond、AIME 2025、IFBench、LiveCodeBench、SciCode、AA-LCR が含まれるようになりました。

現在、すべての数字がサイトで更新されています。人工分析知能インデックス v2.2 👇 のモデルを確認する

28.83K

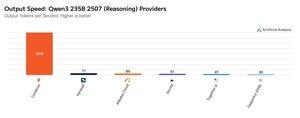

Cerebras は今週、大規模な MoE を非常に高速でホストする能力を実証しており、Qwen3 235B 2507 および Qwen3 Coder 480B エンドポイントを >1,500 出力トークン/秒で起動しました

➤ @CerebrasSystems は、Qwen3 235B 2507 推論と非推論の両方のエンドポイントを提供するようになりました。どちらのモデルも合計パラメータが 235B で、アクティブは 22B です。

➤ Qwen 3 235B 2507 Reasoning は、o4-mini (高) および DeepSeek R1 0528 に匹敵するインテリジェンスを提供します。Non-reasoning バリアントは、Kimi K2 に匹敵し、GPT-4.1 や Llama 4 Maverick をはるかに上回るインテリジェンスを提供します。

➤ Qwen3 Coder 480B には合計 480B のパラメータがあり、35B がアクティブです。このモデルはエージェントコーディングに特に強力で、Qwen3-Coder CLI を含むさまざまなコーディングエージェントツールで使用できます。

Cerebrasの発売は、このレベルのインテリジェンスがこのような出力速度で初めてアクセスできるようになったことを意味し、エージェントの各ステップに数分待たずに推論モデルを使用するなど、新しいユースケースを解き放つ可能性を秘めています。

25.31K

トップ

ランキング

お気に入り