Populaire onderwerpen

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Wat is er nodig voor een computer om de regels van RNA-basispaarvorming te leren?

Mensen trainen grote taalmodellen voor RNA-structuurvoorspelling. Sommige van deze modellen hebben honderden miljoenen parameters.

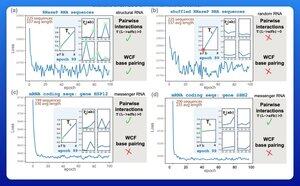

Een opwindend vroeg resultaat is dat deze modellen de regels van Watson-Crick-Franklin-basispaarvorming rechtstreeks uit gegevens leren.

Een onderzoeksgroep aan Harvard besloot te onderzoeken wat het kleinste mogelijke model was dat dit resultaat kon bereiken.

Ze trainden een klein probabilistisch model met slechts 21 parameters met behulp van gradient descent.

Met zo weinig als 50 RNA-sequenties—zonder bijbehorende structuren—kwamen de regels van de basisparing na slechts een paar trainings-epochs naar voren.

Dus het antwoord op hun oorspronkelijke vraag was dat het "veel minder is dan je misschien denkt" om dit type model te leren.

Ik denk niet dat dit betekent dat de grootschalige trainingsinspanningen noodzakelijkerwijs dom of misleidend zijn. Maar dit resultaat suggereert dat er veel efficiëntie en prestaties zijn die nog steeds uit architectuurinnovatie kunnen worden gehaald.

Er is veel onderliggende structuur in de taal van de biologie.

3,43K

Boven

Positie

Favorieten