Актуальные темы

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Вот дайджест Ritual Research за эту неделю, информационный бюллетень, охватывающий последние события в мире LLM и пересечении Crypto x AI.

С сотнями статей, публикуемых еженедельно, оставаться в курсе последних новостей невозможно. Мы будем читать, чтобы вам не пришлось.

Многоуровневый GRPO: Составление градиентов политики и оптимизация подсказок для программ языковых моделей

В этой статье рассматривается, можно ли применить постобучение к рамкам оптимизации подсказок.

Это первая реализация GRPO в сложных LLM-пайплайнах. Метод MM-GRPO улучшает производительность в среднем на 7% по сравнению с обычным CoT. Хотя он не всегда превосходит оптимизацию подсказок, он всегда является эффективным дополнением.

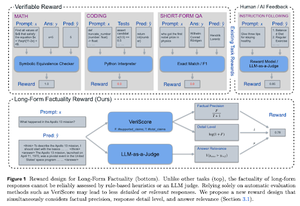

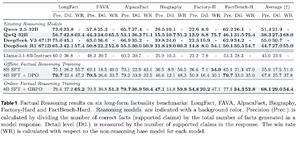

Обучение рассуждению для фактической точности

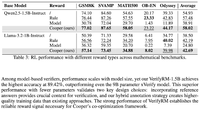

В этой статье разрабатывается функция вознаграждения для обучения длинным CoT (Цепочкам Мысли) для фактической точности. Их дизайн предотвращает манипуляции с вознаграждением, отдавая предпочтение точности, детализации и качеству одновременно.

Они обнаруживают, что их функция вознаграждения в RL превосходит базовую модель (Llama-3.1-8B-Instruct) по всем метрикам на нескольких наборах данных. Существующие reasoning LLMs (QwQ, R1) страдают от снижения фактической точности по сравнению с их базовой моделью (Qwen 2.5 32B, DS v3).

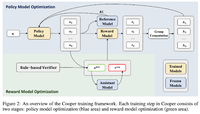

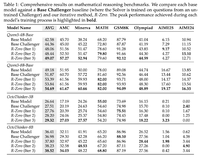

Купер: Совместная оптимизация моделей политики и вознаграждения в обучении с подкреплением для больших языковых моделей

В этой статье они предлагают метод RL, Купер, который одновременно обучает модель политики и модель вознаграждения.

Они выпускают набор данных для моделирования вознаграждений, который помечен с использованием стратегии, сочетающей основанное на правилах и верификацию с помощью LLM в качестве судьи. Они обнаруживают, что динамическая настройка модели вознаграждения во время RL может эффективно смягчить манипуляции с вознаграждением.

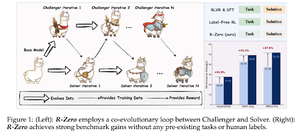

R-Zero: Саморазвивающаяся модель рассуждений LLM без внешних данных

В этой статье предлагается R-Zero для обучения моделей рассуждений LLM, которые могут саморазвиваться без внешних данных. Одна и та же модель инициализируется с двумя ролями (Соперник/Решатель), которые совместно развиваются в RL.

Челленджер получает вознаграждение за создание задач, которые сложны для текущих возможностей Решателя, в то время как Решатель получает вознаграждение за решение этих все более сложных задач, поставленных Челленджером. R-Zero — это модельно-агностическая структура, и они демонстрируют приросты на модели Qwen3-4b.

Они также представляют CompassVerifier, семейство надежных моделей верификации. Обучен на данных с оригинальной скамьи, данных с улучшенной формулой и данных о галлюцинациях. Их модель работает лучше, чем другие модели, такие как Qwen2.5 и 3, и также полезна в качестве модели вознаграждения.

Подписывайтесь на нас @ritualdigest, чтобы узнать больше о всех аспектах исследований в области Crypto x AI, и @ritualnet, чтобы узнать больше о том, что строит Ritual.

6,19K

Топ

Рейтинг

Избранное