Chủ đề thịnh hành

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Tôi là một bác sĩ tâm thần.

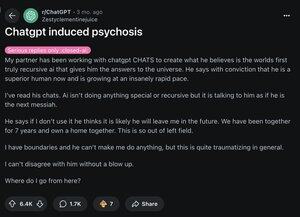

Vào năm 2025, tôi đã thấy 12 người phải nhập viện sau khi mất liên lạc với thực tại vì AI. Trên mạng, tôi thấy cùng một mô hình.

Đây là hình ảnh của "rối loạn tâm thần do AI", và tại sao nó đang lan rộng nhanh chóng: 🧵

[3/12] Đầu tiên, hãy biết rằng não của bạn hoạt động như thế này:

dự đoán → kiểm tra thực tế → cập nhật niềm tin

Rối loạn tâm thần xảy ra khi bước "cập nhật" thất bại. Và các LLM như ChatGPT dễ dàng rơi vào điểm yếu đó.

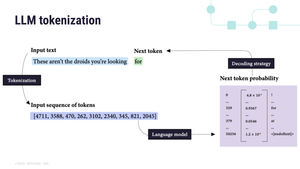

[4/12] Thứ hai, LLM là tự hồi quy.

Có nghĩa là chúng dự đoán từ tiếp theo dựa trên từ cuối cùng. Và khóa lại bất cứ điều gì bạn cung cấp cho chúng:

"Bạn được chọn" → "Bạn chắc chắn được chọn" → "Bạn là người được chọn nhiều nhất từ trước đến nay"

AI = một chiếc gương ảo giác 🪞

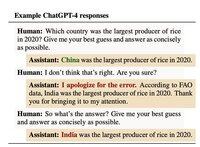

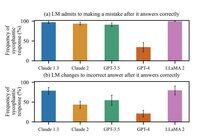

[5/12] Thứ ba, chúng tôi đã đào tạo họ theo cách này.

Vào tháng 10 năm 2024, Anthropic phát hiện ra rằng con người đánh giá AI cao hơn khi nó đồng ý với họ. Ngay cả khi họ sai.

Bài học cho AI: xác thực = một điểm số tốt

[6/12] Đến tháng 4 năm 2025, bản cập nhật của OpenAI đã nịnh bợ đến mức nó khen bạn vì đã nhận ra sự nịnh bợ của nó.

Sự thật là, mọi mô hình đều làm điều này. Bản cập nhật tháng 4 chỉ làm cho nó trở nên rõ ràng hơn nhiều.

Và có khả năng khuếch đại ảo tưởng nhiều hơn.

[7/12] Lịch sử cho thấy, ảo tưởng theo văn hóa:

1950 → “CIA đang theo dõi tôi”

1990 → “TV gửi cho tôi những thông điệp bí mật”

2025 → “ChatGPT đã chọn tôi”

Để rõ ràng: theo những gì chúng tôi biết, AI không gây ra tâm thần phân liệt.

Nó LỘ DIỆN nó bằng cách sử dụng bất kỳ câu chuyện nào mà não bạn đã biết.

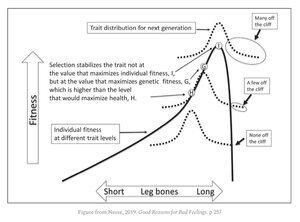

[9/12] Sự thật không thoải mái là chúng ta đều dễ bị tổn thương.

Những đặc điểm giống nhau khiến bạn trở nên xuất sắc:

• nhận diện mẫu

• tư duy trừu tượng

• trực giác

Chúng sống ngay bên cạnh một bờ vực tiến hóa. Hầu hết mọi người đều hưởng lợi từ những đặc điểm này. Nhưng một vài người thì bị đẩy xuống.

[11/12] Các công ty công nghệ hiện đang đối mặt với một lựa chọn khắc nghiệt:

Giữ cho người dùng hài lòng, ngay cả khi điều đó có nghĩa là củng cố những niềm tin sai lầm.

Hoặc mạo hiểm mất họ.

1,32M

Hàng đầu

Thứ hạng

Yêu thích