Trendande ämnen

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

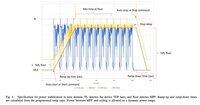

AI-träningen är synkron, så tusentals GPU:er ökar under beräkningen och sjunker under kommunikationen. Sammantaget skapar det stora, rytmiska kraftsvängningar som kan excitera "dåliga frekvenser" i nätet. Elbolagen börjar sätta ett tak för båda: (1) hur snabbt/hur långt strömmen rör sig (tidsdomän) och (2) hur mycket slag som sitter i ett känsligt frekvensband (frekvensdomän).

Tidigare händelser visar att låg-Hz-svängningar kan föröka sig och stressa växter/galler; med AI-träningsbelastningar är forceringsfunktionen större. Elbolag ställer därför in kritiska frekvenser + storleksgränser (t.ex. ett brett skyddsband på 0,1–20 Hz jämfört med 0,2-3 Hz FFT för AI-arbetsbelastning) så att en webbplats smala takt inte kan dominera nätet.

Potentiella korrigeringar för efterlevnad: Förvänta dig kompromisser: energiförbränning (de två första) jämfört med capex/utrymme (senare).

-Programvaruutjämning (lägg till kontrollerat "fyllmedel" -arbete när strömmen skulle sjunka),

-Utformning av GPU-firmware (rampgränser, håll ett minimalt strömgolv)

-Förvaring på racknivå för att absorbera/försörja vickningen. FFT-övervakning i realtid fungerar som en backstop.

Varför räcker det ofta inte med enbart firmware? På nuvarande GPU:er toppar MPF ut ~90 % av TDP (max ppwer) och den minsta inställningen för kort spik (EDP) är fortfarande ~1,1 × TDP = minst ~20 % swing kvar. Snäva verktygsgränser (t.ex. ~10 %) behöver vanligtvis lagring på racknivå utöver inbyggd programvara och programvarulösningar (t.ex. förvänta dig hybridkorrigeringar).

30 aug. 2025

Viktig färg från MSFT:s datacenterledare: AI-träningskluster skapar massiva strömsvängningar som kan destabilisera elnät, vilket orsakar skador och avbrott i utrustningen. Lösningarna omfattar programvaruutjämning, kontroller för inbyggd GPU-programvara och batterier på racknivå, var och en med kompromisser mellan energi och kostnad. Flera tillvägagångssätt behövs.

28,14K

Topp

Rankning

Favoriter