トレンドトピック

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

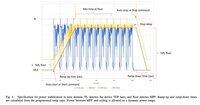

AI トレーニングは同期的であるため、何千もの GPU がコンピューティング中にスパイクし、通信中にサグします。集約すると、グリッドの「悪い周波数」を励起できる大きくリズミカルなパワースイングが生まれます。電力会社は、(1)電力がどれだけ速く/どれだけ遠く移動するか(時間領域)、および(2)敏感な周波数帯域(周波数領域)にどれだけのビートが存在するかの両方に制限を設け始めています。

過去の出来事は、低Hzの振動が植物/グリッドを伝播し、ストレスを与える可能性があることを示しています。AI トレーニングの負荷では、強制関数が大きくなります。したがって、電力会社は臨界周波数+振幅制限(たとえば、0.1〜20Hzの広いガードバンドと0.2〜3HzのAIワークロードFFT)を設定し、1つのサイトの狭いビートがグリッドを支配できないようにします。

コンプライアンスの潜在的な修正: トレードオフを予想してください: エネルギー消費 (最初の 2 つ) と設備投資/スペース (後者)。

-ソフトウェアのスムージング(電力が低下したときに制御された「フィラー」作業を追加)、

-GPUファームウェアシェーピング(ランプ制限、最小電力フロアの維持)

-小刻みを吸収/供給するためのラックレベルのストレージ。リアルタイムFFT監視はバックストップとして機能します。

ファームウェアだけでは不十分な場合が多いのはなぜですか?現在のGPUでは、MPFはTDPの~90%(最大ppwer)を上回り、最小ショートスパイク設定(EDP)は~1.1×TDP =少なくとも~20%のスイングが残っています。ユーティリティの制限が厳しい場合(例:~10%)、通常、ファームウェアとソフトウェアソリューション(ハイブリッド修正など)に加えて、ラックレベルのストレージが必要です。

2025年8月30日

MSFT データセンター リーダーからの重要な色: AI トレーニング クラスターは、電力網を不安定にし、機器の損傷や停電を引き起こす可能性のある大規模な電力変動を引き起こします。ソリューションには、ソフトウェアのスムージング、GPUファームウェア制御、ラックレベルのバッテリーが含まれており、それぞれにエネルギーとコストのトレードオフがあります。複数のアプローチが必要です。

28.16K

トップ

ランキング

お気に入り