Rubriques tendance

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

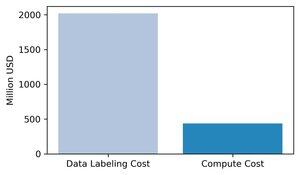

La sagesse actuelle est que le calcul est le facteur le plus important pour l'entraînement de l'IA de pointe. Nous pensons que c'est faux : les données sont le composant le plus coûteux et le plus important de l'entraînement de l'IA.

Nous avons collecté des estimations de revenus pour les principales entreprises de labellisation de données et les avons comparées au coût marginal de calcul pour l'entraînement des meilleurs modèles en 2024. Nos estimations montrent que la labellisation de données est ~3x plus élevée que le coût marginal de calcul pour l'entraînement.

1/8

Notre récent article de blog décompose le véritable coût de l'entraînement des modèles phares d'aujourd'hui avec des chiffres concrets et des études de cas

L'analyse complète est sur Substack :

2/8

Un aperçu de 2024 : nous avons calculé le revenu annuel des principales entreprises de labellisation (Scale, Surge, Mercor, Labelbox, …) et l'avons comparé aux dépenses marginales en calcul pour l'entraînement de GPT-4o, Sonnet-3.5, Mistral-Large, Grok-2 et Llama-3-405B. Résultat : les coûts de labellisation sont environ 3 fois les coûts de calcul marginaux.

3/8

De 2023 à 2024, nous constatons un bond de 88x dans l'industrie du marquage de données, tandis que les coûts de calcul pour l'entraînement n'ont augmenté que de 1,3x. Cela représente un taux de croissance ~70x plus rapide pour le marquage de données.

Notez que nous ne nous attendons pas à ce que les tendances se poursuivent en 2025 et au-delà, car la majeure partie de la croissance provient de Mercor, donc les taux de croissance seront plus faibles, même si le montant total des coûts de données augmente.

4/8

Au-delà des revenus, MiniMax-M1 avait besoin de <1M $ en calcul pour atteindre la qualité de Claude-Opus-4, mais la création d'un ensemble de données RL avec 140k annotations humaines coûterait environ 14M $, soit 28 fois le calcul d'entraînement.

5/8

De même, SkyRL-SQL a égalé GPT-4o sur le texte-à-SQL avec seulement 360 $ de puissance de calcul pour l'entraînement, mais les 600 requêtes annotées par des experts utilisées après l'entraînement ont coûté environ 60 000 $

6/8

Nous encourageons les organisations qui suivent les entrées de l'IA à suivre également les coûts des données humaines, car nous croyons que cela est essentiel pour comprendre les progrès de l'IA

7/8

Co-écrit avec @maxYuxuanZhu

8/8

104,25K

Meilleurs

Classement

Favoris