Populære emner

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Elliot Hershberg

Ordet er ute!

@packyM og jeg var gira på å hjelpe til med å så @Atelfo, @okaymaged og @Convokebio-mannskapet mens jeg var på @notboringco

Forfattere som investerer i forfattere 🤝🧬

Begeistret for denne visjonen.

Convoke20. aug., 01:04

Vi har samlet inn 8,6 millioner dollar for å bygge ledende AI-verktøy for biofarmaindustrien!

Vår såkornfinansiering ble ledet av @kleinerperkins og @_DimensionCap, med deltakelse fra @ACME, @CommaCapital, @Liquid2V, @notboringco, @AudaciousHQ, @Lux_Capital og ledere innen AI og bioteknologi

10,6K

Jeg tror et av de mest lovende aspektene ved AI for legemiddeloppdagelse er fordelen med multimodalitet og muligheten til å bygge modeller for mange forskjellige oppgaver.

I sitt essay fra 2012 som skisserte Erooms lov (legemiddeloppdagelsens eksponentielt synkende FoU-effektivitet), var en av Jack Scannells «diagnoser» for problemet «grunnleggende forskning – brute force»-skjevheten.

Vi har en tendens til å overvurdere effekten av skalering av tidlige oppdagelsesteknologier. Ofte har disse analysene lav "prediktiv validitet" av klinisk suksess.

En måte AI-modeller bidrar til å løse dette problemet på, er at de kan inkorporere mer translasjonsrelevante prediksjoner i de aller tidligste stadiene av oppdagelsen.

Jeg tror dette er det geniale i Brandon og Alex sin visjon hos Axiom. Ved å redusere kostnadene, tiden og friksjonen forbundet med toksisitetstesting, kan den trekkes mye tidligere i oppdagelsesprosessen – så snart du har et molekyl.

Dette er en av de mest radikale avvikene fra molekylær maskinlæring i forhold til tidlig beregningskjemiinnsats.

Et stort antall forskjellige oppdagelseskriterier kan gjøres rede for i en enkelt foroverpassering.

950

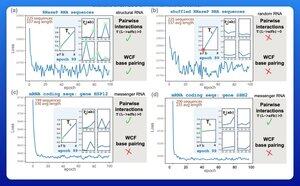

Hva skal til for at en datamaskin skal lære reglene for RNA-baseparing?

Folk trener store språkmodeller for prediksjon av RNA-struktur. Noen av disse modellene har hundrevis av millioner parametere.

Et spennende tidlig resultat har vært at disse modellene lærer reglene for Watson-Crick-Franklin baseparing direkte fra data.

En forskergruppe ved Harvard bestemte seg for å se hva den minste mulige modellen var som kunne oppnå dette resultatet.

De trente opp en liten probabilistisk modell med bare 21 parametere ved hjelp av gradient descent.

Med så få som 50 RNA-sekvenser – uten tilsvarende strukturer – ville reglene for baseparing dukke opp etter bare noen få treningsepoker.

Så svaret på det opprinnelige spørsmålet deres var at det tar "mye mindre enn du kanskje tror" for å lære denne typen modell.

Jeg tror ikke dette betyr at den storstilte opplæringsinnsatsen nødvendigvis er dum eller misforstått. Men dette resultatet antyder at det fortsatt er mye effektivitet og ytelse som fortsatt kan hentes ut av arkitekturinnovasjon.

Det er mye underliggende struktur i biologiens språk.

3,23K

Det er kjempebra å ha ordet for Tahoes serie A.

@nalidoust og @iamjohnnyyu er en fantastisk administrerende direktør/CSO-teknisk gründerduo. @genophoria og @kevansf er begge utrolige forskere. Det er et drømmelag.

Ambisjonsskalaen om å gå etter 1 *milliard* celler på tvers av et bredt spekter av pasientbakgrunner grenser til absurd. Men de bygger infrastrukturen for å gjøre det til en realitet.

Og den kommersielle visjonen er like intens.

Jeg gleder meg til mer av Tahoes historie snart blir delt.

Det er et privilegium å samarbeide med dette teamet hos Amplify.

Nima Alidoust11. aug., 23:25

Vi har samlet inn 30 millioner dollar for å bygge det grunnleggende datasettet for virtuelle cellemodeller: 1 milliard enkeltcellede datapunkter, kartlegging av 1 million legemiddel-pasient-interaksjoner, som skal deles med én partner.

Vårt mål: Flytt grensen - Fra modeller til presisjonsmedisiner som hjelper pasienter.

@tahoe_ai 🧵

6,17K

I biologi fungerer skaleringslover ...

... til de ikke gjør det.

For kondisjonsprediksjon øker ytelsen til proteinspråkmodellen med modellstørrelsen til den platåer og deretter forringes.

Etter hvert som treningstapet (NLL) går ned, begynner modellene å forutsi høyere sekvenssannsynligheter og korrelere mindre med underliggende kondisjon.

Eksempel 10 001 på hvorfor AI for biologi krever nøye vurdering av underliggende distribusjoner, opplæringsmål og dusinvis av andre detaljer.

Skjæringspunktet er rikt, men krever nøye arbeid på tvers av begge disipliner.

13,01K

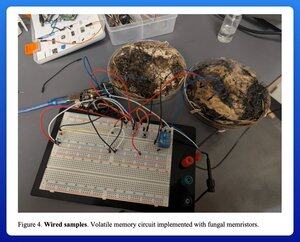

Sliten: Silisiumbaserte datamaskiner

Kablet (bokstavelig talt): soppdatamaskiner

Fra "Bærekraftige memristorer fra Shiitake-mycelium for høyfrekvent bioelektronikk"

Ideen er å bruke adaptiv elektrisk signalering i shiitake (som jeg ikke visste eksisterte) som en erstatning for nevrale organoider for nevromorfe databehandlingsapplikasjoner.

"Våre funn viser at soppdatamaskiner kan gi skalerbare, miljøvennlige plattformer for nevromorfe oppgaver, og bygge bro over bioelektronikk

og ukonvensjonell databehandling.»

100 % en av de mer "ukonvensjonelle" forskningsideene jeg nylig har kommet over ...

907

Elliot Hershberg lagt ut på nytt

Vi snakket med @ElliotHershberg (Partner @AmplifyPartners) om utfordringene innen biovitenskapsteknologi.

«Det har vært en generell følelse av at du kan gjøre enorme fremskritt med nye data og ny teknologi innen biovitenskap.»

"Det viser seg faktisk at det er veldig vanskelig å ta en kur mot kreft."

«Det er gjennombrudd som Nobelprisen for Alphafold. AI har reell innvirkning på vanskelige biologiske problemer.»

"DNA-sekvensering reduseres i kostnad raskere enn Moores lov."

«Folk begynner å skalere modeller, og det blir raskt imponerende.»

7,01K

Hva om influensavaksiner virkelig fungerte?

Og jeg mener *virkelig* fungerte – til det punktet at menneskehetens endemiske forhold til influensa ble historie, ikke en pågående global helseutfordring.

Hva om vi kunne dempe *alle* raskt muterende patogener?

Dette er grunnen til at Jake Glanville grunnla Centivax. Hans livsoppdrag er å "fullføre det Edward Jenner startet" ved å utvikle universelle vaksiner som akselererer menneskehetens overgang til en post-patogen fremtid.

Jake er akkurat den typen teknisk grunnlegger vi ønsker å samarbeide med hos Amplify. Han var en tidlig pioner innen beregningsantistoffdesign ved Pfizer, før han ble en av de første doktorgradsstudentene i Computional & Systems Biology ved Stanford sammen med Davis.

Han har syntetisert et helt liv med arbeid til en distinkt – og noe motstridende – idé for å utvikle universelle vaksiner.

Og teamet han har satt sammen er like ekstraordinært. For eksempel er Centivaxs CMO, Jerry Sadoff, en av de mest produktive vaksineutviklerne i live.

Det er virkelig et privilegium for oss å delta i serie A-syndikatet for Centivax. I løpet av det siste tiåret har Jake og teamet satt sammen en omfattende preklinisk datapakke for deres ledende influensaprogram.

Det eneste gjenværende eksperimentet er å se om dette oversettes til mennesker, som er det denne runden garanterer.

Hvis denne teknologien lykkes, vil virkningen være enorm. Og historien om dette lagets utholdenhet vil kreve en egen bok i bioteknologikanonen.

6,73K

Topp

Rangering

Favoritter

Trendende onchain

Trendende på X

Nylig toppfinansiering

Mest lagt merke til