Argomenti di tendenza

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

François Chollet

Co-fondatore @ndea. Co-fondatore @arcprize. Creatore di Keras e ARC-AGI. Autore di "Deep Learning with Python".

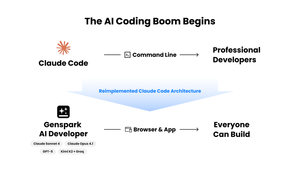

Congratulazioni a Eric e al team di @genspark_ai per il lancio di Genspark AI Developer!

È un IDE completo senza configurazione, che funziona nel tuo browser, come Replit. Descrivi ciò che desideri, ricevi feedback visivo e puoi iterare sull'output.

Puoi scegliere il tuo modello (ad esempio, Claude Opus 4.1, GPT-5, ecc.). Ideale se hai poca esperienza di programmazione e stai cercando uno strumento di vibrazione-coding facile da usare.

25,19K

François Chollet ha ripubblicato

Anteprima ARC-AGI-3: +3 Giochi Rilasciati

Abbiamo aperto 3 giochi precedentemente privati dalla Competizione degli Agenti di Anteprima

Ora 6 giochi sono disponibili per essere giocati online e tramite l'API degli Agenti

Ogni gioco è stato selezionato per ampliare la novità dei giochi pubblici di ARC-AGI-3

Riuscirai a batterli?

38,48K

L'adozione dei LLM tra i lavoratori statunitensi si avvicina al 50%. Nel frattempo, la crescita della produttività del lavoro è inferiore a quella del 2020.

Possono essere fatte molte contro-argomentazioni, ad esempio: "non sanno ancora come essere produttivi con esso, lo usano solo da 1-2 anni", "il 50% è ancora troppo basso per vedere un impatto", "i modelli dell'anno prossimo saranno incredibilmente migliori", ecc.

Ma penso che ora abbiamo abbastanza prove per dire che il punto di discussione del 2023 secondo cui "i LLM renderanno i lavoratori 10 volte più produttivi" (alcuni hanno persino citato 100 volte) probabilmente non è accurato.

Oyvind20 ago, 22:35

L'adozione di LLM è salita al 45,9% tra i lavoratori statunitensi a giugno/luglio 2025, secondo un sondaggio della Stanford/World Bank.

La domanda di inferenza continuerà a crescere, non solo grazie a un numero maggiore di utenti e a un maggiore utilizzo per utente, ma poiché i modelli GenAI più recenti e avanzati richiedono un calcolo di inferenza molto più elevato.

Fonte: Gli effetti del mercato del lavoro dell'intelligenza artificiale generativa, Università di Stanford, Banca Mondiale.

839,24K

Siamo stati in grado di riprodurre i forti risultati del documento HRM su ARC-AGI-1.

Inoltre, abbiamo condotto una serie di esperimenti di ablation per capire cosa ci sia dietro.

Risultati chiave:

1. L'architettura del modello HRM stessa (il fulcro del documento) non è un fattore importante.

2. Il ciclo di raffinamento esterno (appena menzionato nel documento) è il principale motore delle prestazioni.

3. L'apprendimento trasferito tra compiti non è molto utile. Ciò che conta è l'addestramento sui compiti su cui verrà testato.

4. Puoi utilizzare molte meno augmentazioni dei dati, specialmente durante il tempo di inferenza.

I risultati 2 e 3 significano che questo approccio è un caso di *zero-pretraining test-time training*, simile al recente documento pubblicato "ARC-AGI senza pretraining" di Liao et al.

332,63K

Domande aperte sull'economia del ride hailing senza conducente:

1. Quale sarà la riduzione dei costi (rispetto a Uber/Lyft) eliminando il conducente?

2. Quanto aumenta la domanda grazie a questa riduzione dei costi?

3. Cambierebbe significativamente l'esperienza utente (UX) e influenzerebbe la domanda?

4. Vedremo un grande aumento della disponibilità geografica (non c'è bisogno di conducenti = si possono mettere più taxi sulla strada)?

Per 1: il costo del lavoro di una corsa Lyft/Uber, dopo aver considerato tutto il resto, è solo il 20-40% del prezzo, il che limita la riduzione a -40% nel migliore dei casi. Tuttavia, una rete di taxi senza conducente avrebbe costi fissi significativamente più elevati (ingegneri AI, data center) e costi unitari aggiuntivi non nulli (pulizia frequente degli interni, ammortamento dell'hardware per la guida autonoma), quindi realisticamente stiamo parlando più di -15-20%.

Quindi è indubbio che le corse autonome, su larga scala, saranno più economiche rispetto ai servizi di ride hailing attuali. Ma l'entità dell'effetto sarà molto più piccola di quanto la maggior parte delle persone si aspetti. Saranno comunque abbastanza costose.

Per 2: probabilmente non molto -- a causa della tariffazione dinamica, i prezzi già fluttuano più di così, e qualche anno fa Uber stava pesantemente sovvenzionando la domanda, quindi abbiamo alcuni dati su cosa accadrebbe con corse più economiche del 20%. Il mercato totale (TAM) in aree già ben servite da Uber/Lyft potrebbe crescere di circa il 20% in termini di miglia, mentre rimarrebbe costante in termini di dollari.

Per 3: sappiamo già (attraverso i dispiegamenti di Waymo) che le persone preferiscono non avere un conducente in auto, e i clienti insensibili al prezzo sono disposti a pagare di più per quell'esperienza. Non è tutto positivo però: ci sono state preoccupazioni riguardo alla pulizia dell'auto (facilmente risolvibili, ma ciò aumenta i costi unitari). In generale, non penso che il cambiamento dell'UX aumenterà molto il TAM, poiché per la maggior parte delle persone prezzo e disponibilità saranno i fattori critici.

Per 4: questo è più un'incognita. La maggior parte dei costi di una rete autonoma sono costi fissi; i costi unitari incrementali sono principalmente l'ammortamento del costo dell'auto (un errore di arrotondamento) e la pulizia. Questo significa che una rete autonoma ha il potenziale di avere una copertura molto più alta rispetto all'attuale rete Uber/Lyft. Ma non sarà certamente il caso che queste reti si estenderanno *ovunque*, almeno non con un tempo di attesa breve. Penso che vedremo un aumento del TAM da questo effetto, forse +20-30%.

In generale: dovremmo aspettarci un aumento incrementale del TAM in termini di dollari, ma nel complesso il mercato sarà più simile a Uber++ che a un nuovo paradigma di trasporto. La maggior parte delle persone negli Stati Uniti, specialmente al di fuori delle aree densamente popolate, continuerà a guidare la propria auto.

36,81K

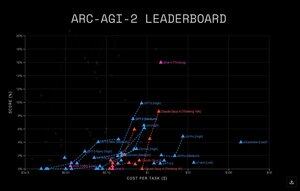

Grok 4 è ancora all'avanguardia su ARC-AGI-2 tra i modelli di frontiera.

15,9% per Grok 4 contro 9,9% per GPT-5.

ARC Prize8 ago, 01:29

GPT-5 su ARC-AGI Valutazione Semi Privata

GPT-5

* ARC-AGI-1: 65.7%, $0.51/task

* ARC-AGI-2: 9.9%, $0.73/task

GPT-5 Mini

* ARC-AGI-1: 54.3%, $0.12/task

* ARC-AGI-2: 4.4%, $0.20/task

GPT-5 Nano

* ARC-AGI-1: 16.5%, $0.03/task

* ARC-AGI-2: 2.5%, $0.03/task

873

Principali

Ranking

Preferiti

On-chain di tendenza

Di tendenza su X

Principali fondi recenti

Più popolari