Trendaavat aiheet

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Vuosi 2025 on agenttien vuosi, ja agenttien avainominaisuus on soittotyökalut.

Claude Codea käytettäessä voin käskeä tekoälyä seulomaan uutiskirjeen, etsimään kaikki linkit startup-yrityksiin ja varmistamaan niiden olemassaolon CRM:ssämme yhdellä komennolla. Tämä voi tarkoittaa kahden tai kolmen eri työkalun kutsumista.

Mutta tässä on ongelma: suuren perustusmallin käyttäminen tähän on kallista, usein rajoitettua ja ylivoimaista valintatehtävään.

Mikä on paras tapa rakentaa agenttijärjestelmä työkalukutsulla?

Vastaus löytyy pienistä toimintamalleista. NVIDIA julkaisi vakuuttavan paperin, jossa väitettiin, että "Pienet kielimallit (SLM) ovat riittävän tehokkaita, luonnostaan sopivampia ja välttämättä taloudellisempia monille kutsuille agenttijärjestelmissä."

Olen testannut erilaisia paikallisia malleja kustannusten vähentämisen vahvistamiseksi. Aloitin Qwen3:30b-parametrimallilla, joka toimii, mutta voi olla melko hidas, koska se on niin suuri malli, vaikka vain 3 miljardia noista 30 miljardista parametrista on aktiivisia kerrallaan.

NVIDIAn paperi suosittelee Salesforce xLAM -mallia – erilaista arkkitehtuuria, jota kutsutaan suureksi toimintamalliksi, joka on suunniteltu erityisesti työkalujen valintaan.

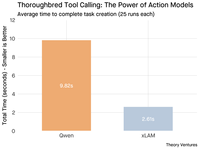

Joten tein oman testin, jossa jokainen malli kutsui työkalua Asana-tehtävieni luettelemiseksi.

Tulokset olivat silmiinpistäviä: xLAM suoritti tehtävät 2,61 sekunnissa 100 %:n onnistumisella, kun taas Qwen kesti 9,82 sekuntia 92 %:n onnistumisella – lähes neljä kertaa kauemmin.

Tämä koe osoittaa nopeuden kasvun, mutta siinä on kompromissi: kuinka paljon älykkyyttä mallissa pitäisi elää verrattuna itse työkaluihin. Tämä rajoitettu

Suuremmissa malleissa, kuten Qwenissä, työkalut voivat olla yksinkertaisempia, koska mallilla on parempi virhetoleranssi ja se voi kiertää huonosti suunniteltuja käyttöliittymiä. Malli kompensoi työkalujen rajoituksia raa'an voiman päättelyn avulla.

Pienemmissä malleissa mallilla on vähemmän kykyä toipua virheistä, joten työkalujen on oltava kestävämpiä ja valintalogiikan tarkempia. Tämä saattaa tuntua rajoitukselta, mutta se on itse asiassa ominaisuus.

Tämä rajoitus eliminoi LLM-ketjutettujen työkalujen yhdistelmävirheprosentin. Kun suuret mallit tekevät peräkkäisiä työkalukutsuja, virheet kasaantuvat eksponentiaalisesti.

Pienet toimintamallit pakottavat parempaan järjestelmäsuunnitteluun, säilyttämällä LLM:n parhaat puolet ja yhdistämällä ne erikoismalleihin.

Tämä arkkitehtuuri on tehokkaampi, nopeampi ja ennustettavampi.

5,41K

Johtavat

Rankkaus

Suosikit