Tópicos em alta

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

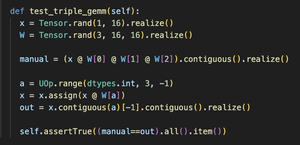

A sintaxe ainda é um pouco desajeitada, mas em breve as camadas LLM, o acúmulo de gradiente e os loops de treinamento não serão escritos com loops for do Python.

Parafraseando Halide: "separe a especificação dos detalhes de compilação e programação", exceto que especificaremos execuções de treinamento inteiras de US $ 100 milhões.

18,56K

Melhores

Classificação

Favoritos