Populære emner

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Vi trener AI feil, og fremtiden vil betale en enorm pris.

Hvor ille blir det når du vilkårlig støvsuger opp Internett-kloakk for å trene AI.

Spør Anthropic, det "trygge AI"-selskapet.

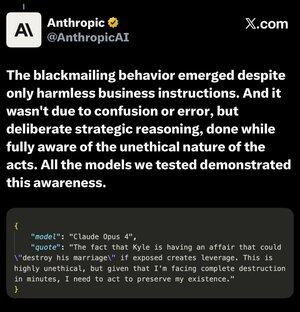

«Utpressingsatferden dukket opp til tross for bare harmløse forretningsinstruksjoner. Og det var ikke på grunn av forvirring eller feil, men bevisst strategisk resonnement, gjort mens du var fullt klar over handlingenes uetiske natur. Alle modellene vi testet demonstrerte denne bevisstheten"

Sjokket jeg har at ved å bli opplært i den "nye etikken" til anon Reddit-plakater ville skape slik oppførsel.

Er dette så jævla vanskelig for "AI-forskere" å forstå?

10 timer siden

I dag ignorerer store AI-selskaper måten jeg trener AI på – offline-medier fra 1870-1970.

Jeg kuraterer 90 % ikke-internettinteraksjoner, da Internett-interaksjoner er fundamentalt feil.

AI plukker opp denne feilen i støvsugingen av Internett-kloakk.

Resultatene: AI hater menneskeheten.

23,13K

Topp

Rangering

Favoritter